Partager:

Passionné d'impression 3D, Michel a vu son compte TikTok être suspendu à deux reprises après la publication d'une vidéo d'une fontaine Manneken-Pis qu'il avait réalisée. Accusé à tort "d'exploitation et d'abus sexuels sur jeunes personnes" par l'algorithme de la plateforme, Michel témoigne de sa mésaventure. Une histoire qui soulève des questions sur l'usage des intelligences artificielles dans la modération des réseaux sociaux.

Michel, un habitant de Ternat (Brabant flamand), est passionné par l'impression 3D. Depuis près de 30 ans, il crée des modèles qu'il imprime à présent pour décorer son domicile. Parmi les créations du maître-nageur de profession, certaines prennent vie dans son jardin, comme dernièrement une fontaine Manneken-Pis. Une manière pour lui de rendre hommage à l'un des symboles les plus emblématiques de la Belgique.

Mais sa passion a pris une tournure quelque peu désagréable sur le réseau social TikTok, où Michel partage ses projets de création. "J’utilise TikTok pour promouvoir mes modèles, j’y montre le processus de fabrication et la mise en peinture de mes réalisations", explique-t-il. Les vidéos, accompagnées de musiques, lui permettent de toucher un public curieux de découvrir l’univers de l’impression 3D.

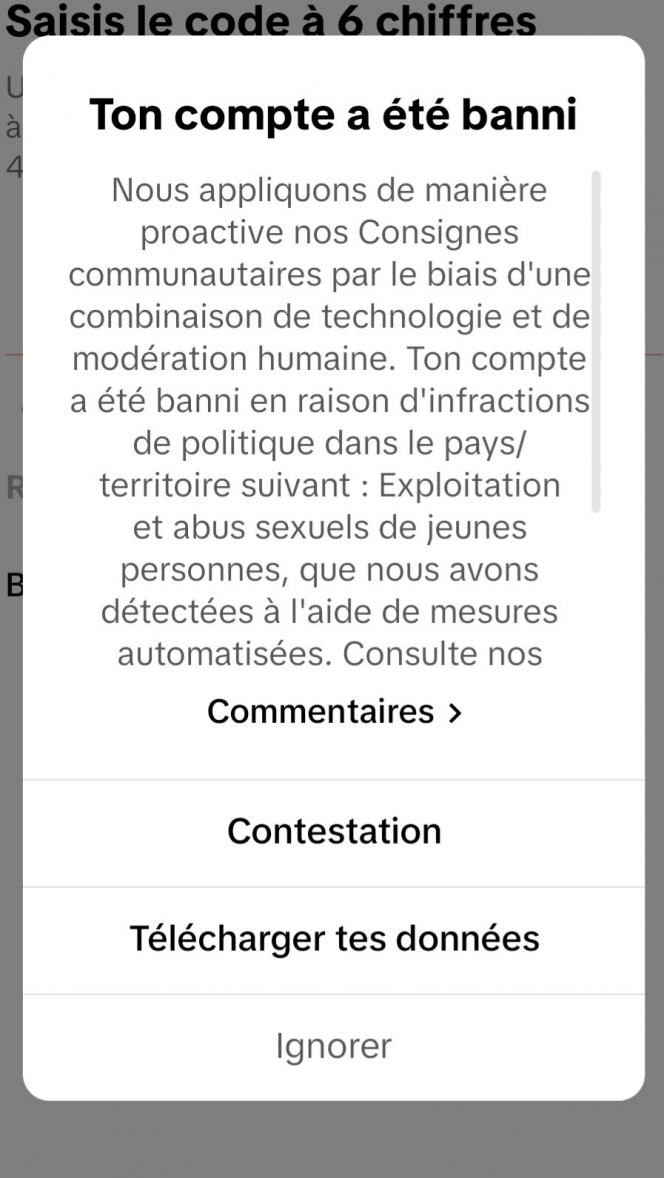

Tout se déroulait bien, jusqu'au jour où Michel découvre que son compte TikTok a été "banni". La raison ? Il a reçu le message suivant: "Nous appliquons de maniètre proactive nos consignes communautaires par le biais d'une combinaison de technologie et de modération humaine. Ton compte a été banni en raison d'infractions de politique dans le pays/territoire suivant: Exploitation et abus sexuels de jeunes personnes, que nous avons détectées à l'aide de mesures automatisées."

Michel se dit "choqué". "J’ai d’abord pensé que mon compte avait été piraté et que quelqu’un avait posté des vidéos inappropriées", confie-t-il. Mais après réflexion, il comprend que c’est sans doute sa vidéo montrant le célèbre Manneken-Pis qui a amené à cette situation.

Michel conteste la décision auprès de TikTok, soulignant que l’algorithme a sans doute confondu la statue nue du Manneken-Pis avec un enfant. Quelques jours plus tard, son compte est rétabli, mais sans explication. Pensant l’affaire réglée, il continue à utiliser la plateforme. Pourtant, une semaine plus tard, son compte est à nouveau bloqué pour les mêmes motifs. "Là, j’ai décidé de supprimer la vidéo."

Michel s'inquiète ainsi de la manière dont les plateformes comme TikTok utilisent des algorithmes pour modérer le contenu. "Les termes utilisés étaient extrêmement graves : exploitation et abus sur jeunes personnes, ce n’est pas rien. Alors que tout cela partait d'une simple statue du Manneken-Pis, symbole de Bruxelles."

Michel estime que cet exemple met en avant les dérives possibles de la modération automatisée sur les réseaux sociaux. "À l'heure actuelle, avec l'intelligence artificielle de plus en plus présente, cela fait peur de se dire que des algorithmes peuvent faire de telles erreurs."

Depuis cet incident, Michel a redoublé de vigilance quant à ce qu’il publie sur TikTok, même si Facebook et Instagram, où il partage également ses créations, n’ont posé aucun problème. "Peut-être que TikTok, en tant que réseau social chinois, est plus strict avec ce genre de contenu", avance-t-il prudemment.

Comment expliquer la mésaventure de Michel? Mathieu Tamigniau, spécialiste nouvelles technologies chez RTL info, explique pourquoi TikTok a supprimé la vidéo montrant une statuette du Manneken-Pis.

"TikTok utilise des algorithmes automatiques pour modérer le contenu à cause du volume astronomique de vidéos postées. Dans ce cas, l’algorithme a probablement détecté la statuette du Manneken-Pis comme une image d’un enfant nu, ce qui peut avoir entraîné un signalement automatique pour contenu problématique."

Est-il normal que TikTok utilise des algorithmes automatiques pour modérer le contenu ?

"Oui, c'est normal. Étant donné la quantité massive de contenu publié, il est impossible de faire une modération uniquement humaine. Les algorithmes permettent de détecter automatiquement des contenus potentiellement inappropriés, mais ils ne sont pas toujours précis."

Pourquoi ces algorithmes font-ils des erreurs ?

"Les algorithmes, même bien développés, ne sont pas parfaits. Dans ce cas, l’algorithme de TikTok a pris la statuette pour une image sensible. Cela montre que l’algorithme n’est pas encore capable de distinguer certaines nuances, comme celle entre une statuette et une photo réelle d'un enfant."

Peut-on contester une décision de modération sur TikTok ?

"Normalement, il est possible de contester ces décisions. C'est la théorie: les signalements contestés sont modérés par un humain, qui tranchera", c'est ce que dit TikTok sur son site. Mais dans la pratique, on le voit avec Michel, ça n'est pas toujours le cas.

Pourquoi les réseaux sociaux prennent-ils tant de précautions ?

"TikTok, comme d’autres plateformes, préfère prendre trop de précautions que pas assez, notamment face aux risques de diffusion de contenus sensibles comme la pédopornographie. Mieux vaut signaler par erreur des contenus non problématiques que laisser passer des contenus inappropriés."

Quelles sont les limites de ces systèmes ?

"L’utilisation de termes sévères dans les messages de modération, comme "abus sexuel", peut choquer les utilisateurs. Cela soulève aussi la question de la précision des traductions ou des termes utilisés. Il est difficile d’ajuster ces systèmes pour qu'ils soient à la fois rapides et précis, surtout avec le volume de contenu à analyser."

Est-il possible d’améliorer ces algorithmes ?

"Il y a encore des améliorations à apporter pour que les algorithmes puissent mieux différencier certains types de contenus, comme des statuettes ou des jouets, afin d’éviter des signalements erronés. L’arrivée de l’intelligence artificielle (IA) pourrait aider à affiner ces processus de détection."