Partager:

E-mails frauduleux, fausses annonces ou clonage vocal : les arnaques en ligne deviennent de plus en plus sophistiquées et difficiles à détecter. Mais alors, comment s’en protéger ?

Une annonce immobilière pour un appartement fictif à Bruxelles, un e-mail semblant provenir d’une banque, ou encore un appel téléphonique imitant la voix d’un proche… Ces trois escroqueries ont un point commun : elles ont été générées grâce à l’intelligence artificielle.

Pour démontrer l’ampleur du phénomène, Guillaume Deterville, expert en cybersécurité, a créé une arnaque fictive. En quelques secondes, il a demandé à ChatGPT de rédiger un e-mail se faisant passer pour une banque et réclamant un acompte pour un crédit personnel.

Le résultat est saisissant…"Il rédige l’entièreté du mail tout seul", explique-t-il. Et avec une fausse adresse e-mail imitant celle de la banque, l’arnaque devient redoutablement crédible.

Des images et des voix manipulées

Le talent de l’IA ne se limite pas aux faux e-mails. Celle-ci peut également générer des photos réalistes, comme celles d’un appartement inexistant, et les publier sur des sites d’annonces immobilières.

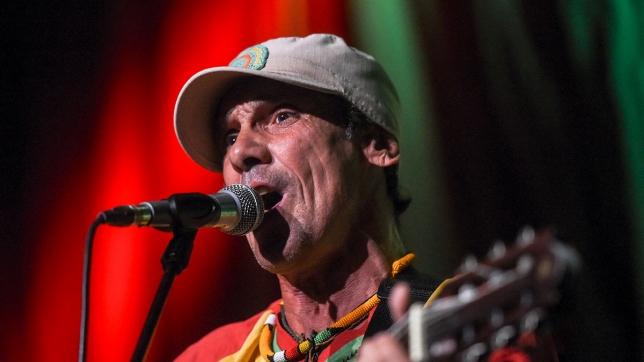

Mais l’arnaque la plus troublante reste le clonage vocal. À partir d’un simple enregistrement de 10 secondes, obtenu via un appel téléphonique ou les réseaux sociaux, l’intelligence artificielle est capable de reproduire la voix d’une personne.

C’est vraiment facile de générer n’importe qui, et de lui faire dire n’importe quoi

"C’est vraiment facile de générer n’importe qui, et de lui faire dire n’importe quoi", alerte Guillaume Deterville.

Une explosion des fraudes en ligne

Face à ces nouvelles techniques, les chiffres des fraudes informatiques s’envolent. En 2023, la Computer Crime Unit de la police fédérale a enregistré plus de 50 000 cas, soit trois fois plus qu’il y a dix ans.

Christophe Axen, directeur adjoint du Regional Computer Crime Unit, souligne la difficulté de mesurer l’impact exact de l’IA sur la criminalité : "On n’arrive pas toujours à détecter son intervention. Mais on sait qu’elle permet de réaliser des arnaques plus crédibles qu’avant".

Autrefois, les tentatives de phishing étaient souvent truffées de fautes d’orthographe et de maladresses visuelles. Aujourd’hui, les contenus générés par IA sont irréprochables, rendant la fraude plus difficile à repérer.

Comment se protéger ?

Face à ces menaces, quelques précautions permettent de limiter les risques :

- Vérifier attentivement l’adresse e-mail de l’expéditeur avant de cliquer sur un lien.

- Utiliser des outils de vérification d’images en ligne pour détecter les fausses photos.

- Mettre en place un mot-clé secret en famille ou entre amis pour confirmer l’identité d’un proche demandant de l’argent par téléphone.

- Une législation encore floue

Pour lutter contre ces fraudes, des experts en cybersécurité, comme ceux du centre IDéLUX, travaillent sur des logiciels de détection des arnaques.

L’Europe a également adopté un règlement sur l’intelligence artificielle. Mais en Belgique, aucune loi spécifique ne punit encore les cyberattaques générées par IA.

"Il n’existe pas, actuellement, de qualification en tant que telle pour punir ces faits. La Belgique doit s’armer d’une législation spécifique", estime Vanessa Matz (Les Engagés), ministre fédérale du numérique.

Si le gouvernement belge prévoit de renforcer la cybersécurité, il mise avant tout sur l’éducation et la sensibilisation pour aider les citoyens à déceler le vrai du faux dans un monde où l’IA devient omniprésente.